Narasi Keamanan dan Paradoks Akses Eksklusif

Narasi mainstream saat ini memuja langkah Anthropic sebagai tindakan kepahlawanan korporasi. Dengan dalih mencegah perlombaan senjata siber, perusahaan yang didukung oleh modal besar Amazon dan Google ini memutuskan untuk mengunci model AI terkuat mereka dari publik. Mereka berargumen bahwa model ini ‘terlalu berbahaya’ jika jatuh ke tangan peretas, sehingga akses hanya diberikan kepada segelintir raksasa teknologi pilihan.

Namun, dari kacamata investigasi kritis, kebijakan ini memicu pertanyaan fundamental: Benarkah ini demi keselamatan umat manusia, atau sekadar strategi ‘safety washing’ untuk membangun parit ekonomi (economic moat)? Ketika sebuah perusahaan mengklaim teknologinya terlalu kuat untuk publik, mereka secara otomatis menciptakan persepsi nilai yang tak terhingga sekaligus menjustifikasi kontrol total atas siapa yang boleh menang dan kalah dalam ekosistem digital masa depan.

Apa yang Dilewatkan: Privatisasi Standar Keamanan Siber

Media arus utama jarang mempertanyakan siapa yang berhak menentukan ambang batas ‘bahaya’. Dalam skenario Anthropic, penentuan risiko dilakukan secara tertutup tanpa audit independen yang transparan. Ini menciptakan preseden di mana perusahaan teknologi bertindak sebagai polisi, hakim, sekaligus eksekutor dalam satu entitas yang sama.

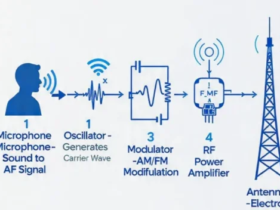

Hal yang sering luput dari perhatian adalah dampak pada komunitas riset keamanan independen. Dengan menutup akses bagi peneliti publik (‘White Hat Hackers’) dan hanya membukanya untuk mitra korporat, Anthropic sebenarnya memperlemah ketahanan siber kolektif. Sejarah perangkat lunak membuktikan bahwa keamanan melalui ketertutupan (security by obscurity) adalah ilusi; peretas negara (state actors) akan selalu menemukan jalan, sementara publik kehilangan kemampuan untuk membangun pertahanan secara terbuka.

Analisis Mendalam: Beneficiary dan Motif di Balik Tirai

Siapa yang paling diuntungkan? Jelas bukan pengguna akhir atau startup kecil. Penerima manfaat utama adalah entitas ‘Big Tech’ yang sudah memiliki kontrak eksklusif dengan Anthropic. Dengan membatasi akses, Anthropic secara efektif melakukan ‘gatekeeping’ teknologi, memastikan bahwa inovasi berbasis AI tingkat tinggi hanya berputar di lingkaran elit yang mampu membayar biaya lisensi mahal atau menyediakan infrastruktur komputasi raksasa.

Motif tersembunyi yang patut dicurigai adalah upaya mendahului regulasi pemerintah. Dengan menetapkan standar ‘bahaya’ versi mereka sendiri, Anthropic sedang mendikte narasi regulasi masa depan yang kemungkinan besar akan menguntungkan pemain besar dan mematikan kompetisi dari sektor open-source. Ini adalah bentuk halus dari ‘regulatory capture’ di mana standar industri dibuat sedemikian rumit sehingga hanya perusahaan bernilai miliaran dolar yang bisa mematuhinya.

Fakta vs Interpretasi: Membedah Klaim Bahaya

Secara fakta, Anthropic memang memiliki model AI dengan kapabilitas penalaran (reasoning) yang melampaui model sebelumnya, dan mereka telah membatasi aksesnya. Namun, secara interpretasi, klaim bahwa pembatasan ini akan ‘menahan laju perlombaan senjata’ adalah sebuah spekulasi. Belum ada data empiris yang menunjukkan bahwa menutup akses model AI secara selektif dapat menghentikan perkembangan alat siber oleh aktor jahat yang seringkali mengembangkan model mereka sendiri secara mandiri.

Dilema Transparansi dan Sumber Alternatif

Pakar etika teknologi independen sering memperingatkan tentang ‘AI Oligopoly’. Berbeda dengan sudut pandang Anthropic, banyak peneliti di Stanford Internet Observatory menekankan bahwa transparansi model adalah satu-satunya cara untuk memastikan akuntabilitas. Jika sebuah model dianggap berbahaya bagi publik, maka mekanisme pengawasannya pun harus melibatkan publik atau badan otoritas independen, bukan hanya keputusan dewan direksi yang memiliki kepentingan profit.

Kesimpulan: Kedaulatan Digital di Tangan Siapa?

Langkah Anthropic ini membawa kita pada persimpangan krusial: Apakah kita bersedia menyerahkan kontrol atas teknologi paling transformatif di abad ini kepada segelintir perusahaan dengan dalih ‘keamanan’? Jika ‘bahaya’ digunakan sebagai alasan untuk menutup pintu inovasi bagi pihak lain, kita harus bertanya: Apakah dunia menjadi lebih aman karena teknologi tersebut dikunci, atau justru lebih berbahaya karena kekuatannya kini terkonsentrasi di tangan yang tak tersentuh pengawasan publik?